Dans un monde où l’intelligence artificielle s’immisce dans chaque interaction numérique, la question cruciale n’est plus seulement “est-ce possible ?” mais “qui en sait le plus sur moi ?” En 2026, la collecte de données personnelles par les IA est devenue un sujet central pour les responsables informatiques, les régulateurs et les utilisateurs eux-mêmes. Les chatbots et les assistants intelligents ne se contentent plus d’exécuter des tâches: ils enregistrent, analysent et croisent une variété croissante d’informations, parfois sensibles, pour améliorer les services, personnaliser les expériences et alimenter les modèles d’IA. Cette réalité souligne l’importance de la confidentialité et de la sécurité informatique comme des piliers stratégiques dans la gestion des données. Face à cela, les organisations publiques et privées doivent non seulement comprendre les mécanismes techniques qui sous-tendent la collecte, mais aussi anticiper les risques de fuite, les implications éthiques et les contraintes réglementaires qui encadrent ce paysage en constante évolution. Le lecteur peut ainsi déchiffrer les dynamiques entre efficacité technologique et protection des données, et s’interroger sur les choix à opérer pour préserver la vie privée sans freiner l’innovation.

Quelle intelligence artificielle récolte le plus vos données personnelles en 2026 ? Panorama des pratiques et des acteurs

Le paysage des IA et de la collecte de données personnelles a connu une accélération marquée ces dernières années, avec une variété croissante d’acteurs et de modèles qui opèrent des politiques de confidentialité très distinctes. En 2026, une étude de référence s’est penchée sur les dix chatbots les plus utilisés et sur leurs pratiques de collecte, en se basant sur les informations publiques dans les politiques de confidentialité et les conditions d’utilisation. Le constat principal est sans appel: toutes les plateformes analysées collectent au moins un type d’information utilisateur, et la moyenne observée se situe autour de 14 catégories de données sur un total de 35 possibles. Cette réalité démontre que la délimitation entre fonctionnalité opérationnelle et collecte destinée à l’analyse, à la personnalisation ou même au marketing est de plus en plus floue. Le rôle des données n’est plus seulement d’assurer le fonctionnement du service; il s’agit aussi d’alimenter des algorithmes d’apprentissage, d’évaluer l’efficacité des interfaces et, parfois, d’alimenter des processus de ciblage publicitaire. Cette double dimension explique pourquoi les entreprises peuvent être tentées d’étendre volontairement le champ des informations capturées, tout en restant soumises à des pressions croissantes pour limiter l’accès à des données sensibles.

Parmi les résultats les plus marquants, la localisation des utilisateurs se distingue comme l’un des types de données les plus couramment collectés, avec près de sept conversations sur dix qui y font référence. Cette poursuite de la géolocalisation n’est pas anodine: elle permet d’adapter les résultats de recherche, d’affiner les services ou de proposer des contenus géo-sélectionnés. D’autres catégories reviennent régulièrement, telles que les coordonnées, les contenus générés, l’historique de navigation et même les données liées à l’audio ou à l’historique de recherche. En miroir, la pratique de collecte varie nettement selon les acteurs. Meta AI est pointé du doigt comme l’un des plus intrusifs, enregistrant une part importante des catégories (près de 95% des catégories sur 35) et incluant même des données financières. D’autres plateformes, comme Gemini lors de l’évaluation initiale, se montrent plus parcimonieuses quant à l’étendue des données collectées et privilégient des informations strictement nécessaires au fonctionnement. ChatGPT, de son côté, a étendu son périmètre, intégrant des données telles que l’emplacement approximatif, des éléments audio et certaines données liées à la publicité, renforçant ainsi le caractère polyvalent de la collecte. À l’inverse, des assistants comme Claude maintiennent une approche plus ciblée, avec un ensemble plus restreint de types de données. Cette hétérogénéité souligne la complexité du paysage et la difficulté pour les utilisateurs de comparer les pratiques d’une IA à l’autre sans décrypter les détails des politiques de données.

Pour mieux comprendre les dynamiques à l’œuvre, il faut aussi prendre en compte les objectifs poursuivis par ces collectes. La collecte peut servir au fonctionnement optimal des services, mais elle peut aussi nourrir des analyses internes et des stratégies de personnalisation, voire des stratégies marketing lorsque les données le permettent. Le lien entre données et performance est clair, mais il porte des risques importants: les conversations et les historiques stockés sur les serveurs peuvent être exposés à des violations. Des incidents signalés dans l’écosystème démontrent que les données archivées, lorsque mal protégées, peuvent devenir vulnérables à des intrusions ou à des ventes non autorisées. Dans ce contexte, les responsables de sécurité doivent non seulement s’appuyer sur des mécanismes techniques solides (sécurité des serveurs, chiffrement, gestion des accès), mais aussi sur une transparence accrue envers les utilisateurs et des choix de conception qui privilégient la protection des données sensibles et l’éthique des algorithmes.

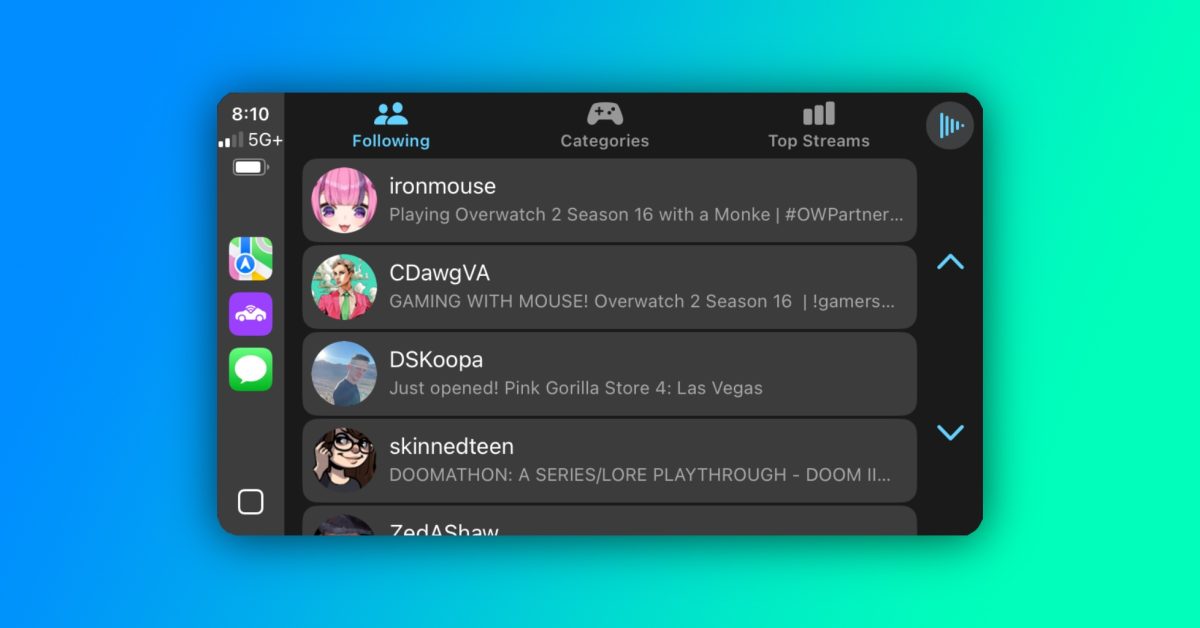

Pour situer les pratiques dans le cadre général, il est utile d’établir un classement synthétique des grandes IA et de leurs habitudes de collecte. Le tableau ci-dessous résume les tendances observées par l’étude et les implications associées.

Éléments clés de l’étude sur les IA et la collecte de données (résumé des chiffres)

Selon l’évaluation, Meta AI apparaît comme l’entité la plus intrusive, captant une large palette de données et allant jusqu’à des informations financières, tandis que Claude présente une courbe de collecte plus stable et plus axée sur le fonctionnement minimal nécessaire. ChatGPT, lui, a élargi son éventail de catégories, incluant des données liées à la localisation et à l’historique de navigation, ce qui soulève des questions sur le contrôle des usages et sur les paramètres de confidentialité qui pourraient être ajustés par les utilisateurs. L’écosystème dans son ensemble démontre l’existence d’un éventail de pratiques, où les consommateurs doivent naviguer entre performance et confidentialité, entre innovation et sécurité.

Pour les acteurs qui souhaitent se référer à des informations publiques de référence, deux sources permettent d’explorer les considérations de 2026 et les comparaisons entre IA et vie privée. D’un côté, une analyse axée sur les données et les questions de confidentialité peut être consultée dans l’article intitulé “IA et collecte de données personnelles en 2026” accessible sur IA et collecte de données personnelles en 2026. De l’autre, les conclusions d’une étude publiée dans Les Numériques proposent une lecture croisée sur “Quelle IA protège le mieux votre vie privée ?”. Pour comprendre les nuances et les critères qui différencient les offres, lire Quelle IA protège mieux votre vie privée ?. Ces ressources permettent d’éclairer les choix organisationnels et les décisions de conception qui influent sur la collecte et la sécurité des données.

Les types de données captées par les IA et les usages qui en découlent: risques, bénéfices et mécanismes

Les pratiques de collecte décrites dans les évaluations 2026 montrent une diversité impressionnante des catégories de données exploitées. Au-delà des informations directement liées au service (identifiants, préférences, commandes, historiques), certaines entités collectent des données sensibles ou potentiellement délicates. Les informations telles que les contenus générés par l’utilisateur, l’historique des recherches, les données de localisation et, dans certains cas, des éléments biométriques ou des opinions personnelles font partie des flux interconnectés qui alimentent les algorithmes. Cette granularité peut améliorer la pertinence des résultats, la personnalisation et l’efficacité des assistants, mais elle augmente aussi la surface d’exposition en cas de violation de données ou de mauvaise gestion des accès.

Les risques associés à cette collecte sont multiples. D’un point de vue sécurité informatique, la centralisation de données permet une attaque unique et potentiellement dévastatrice si les protections se révèlent insuffisantes. D’un autre côté, les questions de confidentialité et de consentement se complexifient lorsque les utilisateurs n’ont pas une vue claire sur l’étendue des données collectées ou sur les usages précis qui en découlent. Des incidents passés rappellent que des clusters de données peuvent être exposés, avec des impacts sur des historiques de discussions ou des données sensibles. Dans ce cadre, les organisations gagneraient à adopter une approche de conception axée sur le « privacy by design », en limitant les collectes au strict nécessaire, en introduisant des contrôles par défaut favorables à la protection des données et en renforçant la traçabilité des usages des données.

L’utilisateur et le responsable de la sécurité doivent aussi comprendre l’importance des paramètres de confidentialité disponibles, qui permettent souvent de limiter l’étendue des données collectées ou d’imposer des garde-fous sur l’utilisation des données pour des finalités non essentielles. En parallèle, les développeurs et les opérateurs d’IA peuvent tirer parti d’initiatives publiques et volontaires pour accroître la transparence et expliquer clairement les finalités des collectes et les mécanismes de protection mis en œuvre. Une communication claire et une gouvernance robuste des données deviennent alors des éléments différenciants pour les services qui souhaitent gagner la confiance des utilisateurs et des partenaires.

Pour aider les décideurs à y voir plus clair, voici une liste synthétique d’éléments à surveiller lors de l’évaluation des plateformes IA:

- Transparence des finalités de collecte et de conservation des données

- Contrôles par défaut sur la collecte des données sensibles

- Sécurité des données (chiffrement, archivage, accès restreint)

- Gouvernance des données et traçabilité des usages

- Compatibilité avec les cadres réglementaires locaux

L’étude de Surfshark et les analyses connexes soulignent également un point clé: la gestion des données ne peut être efficace sans une culture organisationnelle qui priorise la vie privée et l’éthique des algorithmes. Pour les organisations publiques et privées, cela implique de mettre en place des politiques de confidentialité robustes, d’intégrer des audits réguliers et de favoriser une communication accessible sur les choix effectués par les IA en matière de collecte et d’usage des données personnelles.

Transparence, réglementations et bonnes pratiques pour protéger la vie privée à l’ère des IA

La protection des données et la confidentialité ne relèvent pas uniquement d’un choix technique: elles dépendent aussi d’un cadre clair, de règles de conformité et d’un dialogue continu avec les utilisateurs. En 2026, les exigences de transparence vont au-delà du simple affichage d’une politique de confidentialité: elles exigent des explications sur les finalités de collecte, les catégories de données utilisées, les partenaires impliqués et les destinataires des informations. Les organisations doivent également documenter les flux de données et démontrer comment les données sensibles sont protégées contre les risques d’accès non autorisé ou d’usage abusif. Cette approche contribuera à construire la confiance, à réduire les inquiétudes liées à la surveillance et à assurer la sécurité des systèmes d’information.

Les bonnes pratiques utilisées aujourd’hui incluent la minimisation des données, la définition de cycles de rétention stricts et l’adoption de mécanismes de consentement granulaire. Par exemple, les organisations peuvent proposer des paramètres permettant à l’utilisateur de limiter l’utilisation de ses données à des finalités strictement nécessaires au fonctionnement du service, tout en offrant des options de suppression ou d’exportation des données personnelles. En outre, les politiques de sécurité doivent inclure des mesures de détection et de réaction rapide en cas d’incident, ainsi que des procédures claires pour informer les utilisateurs concernés et les autorités compétentes lorsque nécessaire. Dans ce contexte, les liens entre sécurité informatique et conformité deviennent évidents: sans une posture défensive robuste, même les meilleures architectures techniques ne suffisent pas à prévenir les risques.

Pour les acteurs qui souhaitent approfondir les questions de protection des données et de réglementation, des ressources spécialisées et des études indépendantes apportent des analyses utiles et des comparaisons entre les pratiques des différentes IA. En complément, il est utile d’explorer les perspectives et les défis autour des technologies émergentes et de leur impact sur la vie privée, en se fondant sur des publications et des synthèses disponibles dans le secteur, notamment les analyses spécialisées liées à l’IA et à la collecte de données personnelles.

Cas d’usage et recommandations concrètes pour les organisations et les équipes informatiques

Les ensembles de données collectées par les IA peuvent influencer une grande variété de scénarios professionnels: service client automatisé, assistants opérationnels, opérations de sécurité, analyse prédictive et bien d’autres. Dans ce contexte, les responsables informatiques et les décideurs doivent évaluer les risques et les opportunités associées à l’intégration de ces technologies, en privilégiant des solutions qui équilibrent performance et protection des données. Une approche proactive consiste à établir des cadres de gouvernance des données impliquant les parties prenantes, à définir des indicateurs de conformité et à mettre en place des processus d’audit réguliers pour évaluer les pratiques de collecte et d’utilisation des données. Cela permet d’éviter les dérives et de garantir que les outils d’intelligence artificielle opèrent dans le cadre des obligations légales et éthiques.

À titre d’exemple, l’adoption d’outils d’IA dans la sphère publique et le secteur privé doit s’accompagner de plans de gestion des données qui prévoient des contrôles d’accès, des politiques de conservation et des mécanismes de retrait des données lorsque cela est nécessaire. De plus, les organisations peuvent tirer parti de solutions qui offrent des paramètres de confidentialité avancés, des rapports d’audit et des outils de notification des utilisateurs en cas d’usage des données. Cette approche favorise la confiance et sécurise les chaînes opérationnelles, tout en soutenant l’innovation technologique et la compétitivité.

Pour faciliter l’action, il est utile de disposer d’un cadre pratique et adaptable. Par exemple, les entreprises peuvent:

- Mettre en place des revues de données périodiques intégrant des responsables métiers et des experts sécurité.

- Établir des profils de risque spécifiques à chaque type d’IA et ajuster les contrôles en conséquence.

- Introduire des mécanismes de consentement clair et simple pour les utilisateurs finaux.

- Promouvoir une culture de formation continue autour des données personnelles et de la sécurité des systèmes d’information.

Enfin, l’analyse des pratiques des IA en 2026 souligne que la frontière entre innovation et protection des données n’appartient pas uniquement au domaine technologique. Elle dépend aussi de la manière dont les organisations communiquent, expliquent les choix faits par les algorithmes et garantissent que les données personnelles sont utilisées de manière responsable. En associant des contrôles techniques robustes à une transparence explicite et à une gouvernance efficace, les entreprises peuvent tirer parti des avantages de l’intelligence artificielle tout en préservant la sécurité et la vie privée des utilisateurs.

Tableau synthèse des données collectées par les IA les plus utilisées en 2026

| Plateforme IA | Types de données collectées (exemples) | Pourcentage approximatif des catégories couvertes | Objectifs principaux |

|---|---|---|---|

| Meta AI | Localisation, coordonnées, données financières, contenu généré, données biométriques | ≈ 33/35 | Fonctionnement, personnalisation avancée, marketing |

| ChatGPT | Localisation approximative, audio, historique de navigation, données publicitaires | ≈ 17 | Amélioration du service, personnalisation, publicité |

| Claude | Données opérationnelles, paramètres nécessaires au fonctionnement | ≈ 13 | Utilisation efficace, sécurité des échanges |

| Gemini | Données sensibles, historiques d’utilisation, préférences | ≈ 15 | Performance et résultats personnalisés |

Pour approfondir les enjeux et les chiffres autour de la collecte, il est utile de consulter les analyses spécialisées et les rapports de référence disponibles sur le sujet, y compris les évaluations publiques et les synthèses de l’année 2026. Des lectures complémentaires peuvent éclairer les choix stratégiques et les bonnes pratiques adoptées pour concilier les bénéfices de l’IA et la protection des données personnelles.

Pour approfondir les enjeux, les lecteurs intéressés peuvent aussi consulter des ressources spécialisées sur l’architecture des systèmes, la sécurité des données et la manière dont les technologies émergentes influencent les processus de collecte et de surveillance. Dans ce contexte, la collaboration entre les équipes IT, les équipes métiers et les responsables de la conformité devient un facteur clé de réussite. Des lectures complémentaires et des analyses indépendantes offrent des points de vue utiles pour les décideurs qui veulent faire progresser la protection des données tout en tirant parti des capacités offertes par l’intelligence artificielle.

- Adopter une approche de privacy by design dès la conception des systèmes IA

- Établir des mécanismes de consentement granulaire et des politiques de rétention claires

- Renforcer la sécurité des stocks de données et la gestion des accès

- Établir des audits réguliers et des rapports de conformité accessibles

- Favoriser la communication transparente sur les objectifs et les usages des données

Pour ceux qui souhaitent aller plus loin dans l’analyse et l’évaluation des pratiques, des ressources publiques et privées pertinentes peuvent être consultées, telles que les ressources sur les tendances IA 2026 ou les guides dédiés à la protection des données dans les environnements d’IA. Ces références offrent des points d’appui solides pour les décideurs et les professionnels qui doivent faire face à des enjeux complexes et évolutifs.

Quelles données les IA collectent-elles principalement en 2026 ?

Les principales catégories comprennent la localisation, les données de navigation, les contenus générés, les échanges audio et les informations publiques utilisées pour améliorer le service et personnaliser les résultats.

Comment évaluer la protection des données lors du choix d’un assistant IA ?

Comparer les politiques de confidentialité, les options de consentement granulaire, les mécanismes de chiffrement, les possibilités d’exportation/suppression des données et les audits indépendants.

Quelles mesures les organisations peuvent-elles prendre pour limiter la collecte inutile ?

Adopter une approche privacy by design, limiter les données collectées au strict nécessaire, mettre en place des cycles de rétention et rendre les pratiques de surveillance transparentes pour les utilisateurs.

Où trouver des ressources pour comprendre les risques et les meilleures pratiques ?

Consulter des analyses spécialisées et des rapports comme ceux publiés par Surfshark, Les Numériques et les publications professionnelles du secteur sécurité et données personnelles.