La mise en place d’un LLM en local est devenue une réalité accessible en 2026 pour les entreprises comme pour les individus qui souhaitent garder la maîtrise de leurs données et de leurs coûts d’inférence. Cependant, le simple fait d’installer un modèle de langage sur sa machine ne suffit pas à garantir une sécurité opérationnelle. L’enjeu est de concevoir une architecture robuste, qui transforme la promesse de l’« installation locale » en une pratique réellement sécurisée et conforme aux exigences modernes de protection des données, de gestion des accès et de traçabilité. Le présent guide explore les contours d’une sécurité optimale autour de l’installation locale de LLM, en mettant l’accent sur les choix matériels, les mécanismes d’authentification, les bonnes pratiques de déploiement et les pièges courants à éviter. Il s’appuie sur des expériences récentes et des retours d’entreprises qui ont franchi le pas, tout en proposant des recommandations pratiques et vérifiables pour 2026 et au-delà.

Installation locale de LLM et architecture matérielle pour une sécurité optimale

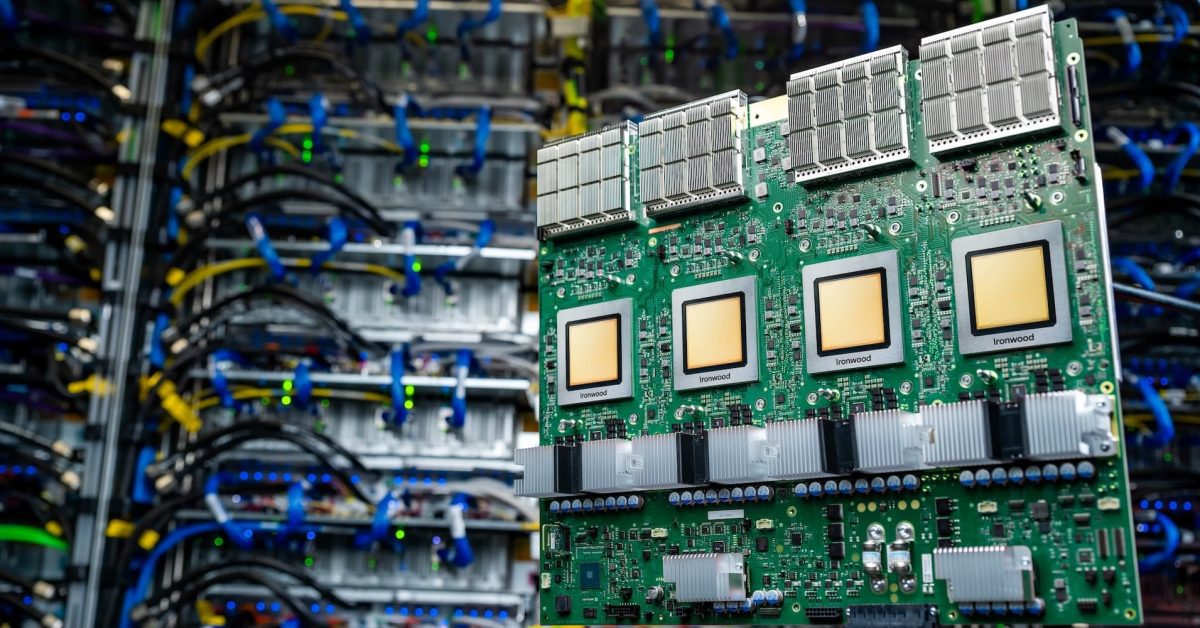

La première étape d’une installation locale réussie repose sur une adéquation rigoureuse entre les ressources matérielles et la taille des modèles envisagés. Le cœur du calcul se situe dans la mémoire vive graphique (VRAM) de la carte graphique. Plus le modèle est volumineux, plus la VRAM nécessaire grimpe, même après quantification. Dans la pratique, un modèle dit « 7B » peut tenir en environ 4 à 5 Go de VRAM lorsque l’on opère une compression standard, tandis qu’un modèle « 14B » exige environ 8 à 10 Go et un modèle « 70B » peut nécessiter 32 Go ou davantage. Cette relation n’est pas arbitraire: elle reflète la manière dont les paramètres du modèle sont chargés et accédés pendant l’inférence. Ainsi, le dimensionnement matériel doit précéder le choix du modèle, afin d’éviter des goulots d’étranglement qui forcent des compromis sur la latence, la qualité des réponses et la stabilité du système.

Pour illustrer, il est utile de dresser une grille pratique :

| Modèle (paramètres) | VRAM typique en 4 bits | Exemple de matériel recommandé |

|---|---|---|

| 7B | 4 à 5 Go | RTX 3060 12 Go, Mac M2 Pro 16 Go |

| 14B | 8 à 10 Go | RTX 4070 12 Go, Mac M4 Pro 24 Go |

| 70B | 32 à 35 Go | RTX 5090 32 Go, Mac M4 Max 64 Go |

Au-delà de la VRAM, d’autres paramètres entrent en jeu: la bande passante mémoire, le débit du CPU, la capacité de stockage rapide et les solutions de refroidissement. Un choix prudent consiste à adapter le modèle au matériel disponible et, en parallèle, à évaluer des stratégies de déploiement hybride (par exemple, exécuter des couches critiques sur GPU dédié et effectuer des prétraitements sur CPU). Dans tous les cas, l’objectif est de maintenir des temps de réponse compatibles avec les usages métier tout en évitant d’exposer le système à des risques de surcharge ou d’instabilité.

Sur le plan de la sécurité, l’installation locale ne se résume pas à l’installation d’un binaire. Elle suppose une configuration pensée dès le départ autour des notions de cryptographie, de pare-feu et de gestion des accès. Le matériel n’est qu’un premier rempart: les mécanismes logiciels et les contrôles de sécurité qui entourent le déploiement constituent le cœur du dispositif de protection des données et des informations sensibles. Pour ces raisons, chaque organisation est invitée à documenter sa stratégie matérielle et logicielle, à revoir périodiquement ses hypothèses et à tester régulièrement la résilience du système face à des scénarios d’attaque réalistes.

Pour approfondir les mécanismes et les choix d’installation locale et sécurisée, consulter des ressources spécialisées peut s’avérer utile. Par exemple, des guides et des retours d’expérience décrivent comment articuler matériel, outils et bonnes pratiques pour atteindre une configuration sécurisée et conforme. Voir, par exemple, des analyses sur les meilleures pratiques d’installation locale et les solutions recommandées pour lesquelles l’infrastructure est dimensionnée et sécurisée de manière holistique. Installation locale de LLM et conseils pratiques et Sécurité renforcée pour l’exécution locale des LLM offrent des synthèses utiles pour comprendre les choix et les pondérations à effectuer.

En parallèle, un apport méthodologique est nécessaire pour la gestion des risques et la conformité. La sécurité physique et la sécurité logique doivent être considérées ensemble: l’accès physique au matériel, les mises à jour logicielles, et les mécanismes d’authentification et de chiffrement doivent être alignés sur une politique unique. Des pratiques comme le chiffrement des volumes de stockage, la réduction des droits (least privilege) et la segmentation réseau permettent de limiter l’étendue d’une éventuelle compromission et de préserver l’intégrité des données et des modèles.

En somme, l’installation locale d’un LLM est une étape stratégique qui exige une approche intégrée: dimensionnement matériel rigoureux, choix du modèle adapté, et configuration sécurisée dès le départ. Cette approche permet d’allier agilité opérationnelle et contrôle continu sur les flux d’information et les accès, tout en se préparant à répondre aux exigences réglementaires à venir et aux défis d’un paysage numérique en constante évolution.

Exemples concrets et scénarios de dimensionnement

Dans une grande administration, une équipe chargée de l’IA peut commencer par un modèle 7B pour des tâches de rédaction et de classification simples, puis évaluer une montée en charge vers un 14B lorsque les besoins évoluent vers des analyses plus fines et des dialogues plus riches. La décision dépendra surtout des contraintes matérielles et des objectifs opérationnels. Par exemple, un département peut viser une latence moyenne inférieure à 200 ms pour la génération de texte, tout en garantissant une précision raisonnable des résultats et une robustesse face à des entrées non prévues. Le succès passe par un cycle itératif: mesurer, ajuster, sécuriser, puis tester à nouveau. Cette rigueur est au cœur d’une stratégie de sécurité informatique qui ne laisse pas les données exposées à des risques évitables et qui s’aligne sur les exigences légales et institutionnelles.

Authentification et gestion des accès au cœur du système

Pour éviter les brèches, l’accès au point d’entrée du modèle nécessite une authentification robuste. La pratique recommandée consiste à mettre en place une authentification par jeton (token JWT) et à définir des rôles clairs, déterminant qui peut interroger le modèle, modifier sa configuration ou consulter les journaux d’activité. Cette séparation des droits est essentielle pour limiter les dégâts potentiels en cas de compromission d’un compte utilisateur. Une telle approche permet aussi d’auditer les interactions et de démontrer la conformité lors des contrôles internes ou externes. L’authentification n’est pas une option, mais une brique indispensable de la sécurité d’un déploiement local et responsable.

Pour approfondir les mécanismes d’authentification et d’autorisation, il est utile de consulter les guides sur les bonnes pratiques d’installation sécurisée et les systèmes de gestion des identités. Des ressources spécialisées décrivent comment articuler les politiques d’accès, les jetons et les contrôles de session pour garantir une sécurité homogène sur l’ensemble du système. Bonnes pratiques matérielles et outils pour LLM locaux et Open source et architecture de sécurité autour des LLM locaux offrent des repères complémentaires sur la gestion des identités et des accès dans un cadre local.

En parallèle, la pratique du chiffrement des fichiers du modèle et l’isolation des poids dans des volumes chiffrés montés en lecture seule renforcent la protection contre les copies non autorisées. La cryptographie, associée à une gestion rigoureuse des clés et des droits d’accès, est essentielle pour prévenir les exfiltrations et les manipulations malveillantes. Un déploiement responsable suppose aussi la traçabilité des actions et une politique claire de conservation des journaux, afin d’assurer la conformité et la gouvernance des données au fil du temps.

Isolation des données et protection de la connaissance interne

Le déploiement d’un LLM en local peut impliquer une connexion avec une base documentaire interne via une architecture de retrieval-augmented generation (RAG). Cette intégration permet au modèle d’enrichir ses réponses en consultant des documents internes, mais elle introduit aussi des risques spécifiques: si la base vectorielle associée n’est pas correctement protégée, des profils non autorisés pourraient accéder à des informations sensibles. Le principe fondamental est le cloisonnement par couche et par équipe: le système de gestion des accès doit refléter les réalités organisationnelles, avec des quotas et des permissions spécifiques pour chaque projet ou département. Dans ce cadre, l’isolation des données ne se limite pas à l’accès au modèle, mais s’étend à l’ensemble des flux d’information qui transitent entre le LLM et les référentiels internes.

Pour sécuriser l’environnement, il convient de chiffrer les volumes de poids et de limiter les permissions d’accès en lecture seule lorsque nécessaire. Les fichiers des poids, qui peuvent peser des dizaines de gigaoctets, constituent une cible naturelle pour les tentatives de copie. En les protégeant par des mécanismes de chiffrement et en s’assurant que seuls les processus d’exécution peuvent y accéder, on réduit fortement le risque d’exfiltration. Par ailleurs, la base documentaire connectée au modèle nécessite une protection équivalente, avec un contrôle d’accès granulaire et une séparation nette des droits pour chaque segment organisationnel. La consolidation d’un cadre de sécurité autour du RAG est donc une condition sine qua non d’un déploiement fiable et conforme.

Pour approfondir la question du cloisonnement et des risques associés au RAG, les guides spécialisés présentent des schémas opérationnels et des scénarios de déploiement. Des ressources en ligne détaillent les mécanismes de sécurisation des bases de connaissances et proposent des bonnes pratiques pour éviter les failles communes, notamment celles liées à l’exposition involontaire des données internes. En complément, une sélection de ressources propose des retours d’expérience concrets sur la sécurisation des chaînes de traitement et la protection des informations sensibles dans des environnements LLM locaux.

Bonnes pratiques et pièges à éviter pour une installation sécurisée

La sécurité d’un déploiement local dépend autant des choix techniques que des habitudes opérationnelles. Une règle fondamentale est d’éviter les sources non vérifiées lors du téléchargement des modèles. Les modèles open source proviennent généralement de dépôts connus comme Hugging Face ou les bibliothèques officielles, mais des versions altérées peuvent circuler sur des canaux non officiels. Le risque consiste à introduire des biais, des portes dérobées ou des comportements indésirables qui ne se révèlent qu’à l’usage. Le réflexe consiste à s’en tenir aux sources officielles et à vérifier systématiquement l’éditeur avant toute installation.

Autre écueil fréquent: l’exposition du point d’accès réseau sans protection. Même si les outils locaux, tels qu’Ollama, LM Studio ou Jan, permettent une exécution hors ligne ou sur réseau local, une configuration mal maîtrisée peut ouvrir le système à des requêtes non authentifiées. L’absence de couches d’identification et l’absence de contrôles d’accès exposent le modèle à des usages non prévus et potentiellement risqués. L’ajout d’une authentification et d’un système de gestion des sessions est une étape non négociable pour limiter les risques et garantir une traçabilité des requêtes.

Par ailleurs, l’attention doit être portée sur les logs et le cadre réglementaire. Nombreuses installations locales ignorent la journalisation des requêtes, ce qui compromet la traçabilité et la conformité. Avec l’entrée en vigueur progressive de l’AI Act en Europe et l’obligation de gouvernance des données, les organisations doivent veiller à ce que les journaux d’inférence soient stockés, traités et, si nécessaire, anonymisés pour se conformer au RGPD. Le non-respect de ces obligations peut conduire à des coûts élevés et à des risques juridiques importants. Enfin, le piège le plus répandu demeure la fausse sécurité associée à la simple proximité « locale ». Le raisonnement « les données restent sur ma machine » peut masquer des vulnérabilités similaires à celles observées dans les déploiements cloud, comme l’injection de prompt ou la fuite d’informations par des requêtes malveillantes. Une approche rigoureuse, avec des contrôles continus et des audits, est nécessaire pour éviter ce genre d’écueil.

Pour enrichir ce paragraphe et prendre en compte les retours d’expérience, consulter les ressources dédiées à l’installation sécurisée peut être utile. Elles expliquent comment sécuriser la configuration, déployer des mécanismes de cryptographie et mettre en place des pare-feu et des règles de gestion des accès adaptées à une architecture LLM locale. Des ressources complémentaires abordent les bonnes pratiques et les pièges à éviter, notamment en matière de gestion des dépendances et de mise à jour des modèles. Bonnes pratiques matérielles et outils pour LLM locaux et Sécurité renforcée pour l’exécution locale des LLM offrent des cadres conceptuels utiles pour cadrer la démarche et renforcer le niveau global de sûreté.

Plan d’action concret et scénarios d’usage

Pour passer de la théorie à une mise en œuvre opérationnelle, une feuille de route claire est indispensable. Ci-dessous une proposition d’étapes pratiques et vérifiables, adaptée à des organisations publiques et privées.

- Établir un périmètre de sécurité: cartographier les flux de données, les accès et les dépendances.

- Choisir le modèle et dimensionner l’infrastructure en fonction de la VRAM disponible et des exigences de latence.

- Mettre en place l’authentification et la gestion des accès: tokens JWT, rôles, et séparation des droits.

- Isoler les poids et les données sensibles dans des volumes chiffrés et en lecture seule lorsque c’est possible.

- Connecter les données internes via un RAG sécurisé, avec un cloisonnement strict et des contrôles d’accès dédiés.

- Activer la journalisation et assurer la conformité RGPD et les obligations liées à l’AI Act.

- Test de résilience et exercices de détection d’intrusion pour simuler des scénarios réels et ajuster les mesures.

Ce plan d’action peut être enrichi par des retours d’expérience et des cas d’usage précis. Par exemple, une unité opérationnelle peut déployer le LLM local pour la rédaction de rapports et l’analyse rapide de documents internes, tout en conservant les données sensibles sur des volumes chiffrés et en auditant les requêtes via des logs centralisés. De tels scénarios renforcent la sécurité et offrent une valeur métier tangible, notamment en termes de réduction des coûts et d’accélération des processus décisionnels. Pour ceux qui souhaitent aller plus loin, des guides détaillés proposent des approches pas à pas et des check-lists prêtes à l’emploi, couvrant à la fois l’aspect matériel et l’aspect logiciel.

Pour compléter ce chapitre, deux ressources à consulter permettent d’approfondir les aspects techniques et organisationnels. Le guide d’installation locale et les bonnes pratiques de sécurité présentent des éléments concrets pour structurer le déploiement. Mettre en place un serveur LLM en entreprise et Guide complet LLM local pour débutants apportent des cadres opérationnels et des exemples d’usages qui facilitent la mise en œuvre.

Pour les entreprises qui veulent pousser l’intégration encore plus loin, l’idée est de combiner une architecture sécurisée avec des processus d’audit et de gouvernance, afin d’assurer une conformité continue tout en tirant parti des capacités des modèles de langage locaux. Dans ce cadre, des ressources complémentaires proposent des retours d’expérience et des analyses sur les mécanismes de sécurisation, les choix technologiques et les pratiques de déploiement adaptées à des environnements complexes et sensibles.

FAQ

Quelle est la première étape pour sécuriser une installation locale de LLM ?

Commencer par dimensionner correctement le matériel en fonction de la taille du modèle visé et établir les fondations de sécurité: authentification renforcée, chiffrement des volumes et contrôle des accès, afin de limiter les risques dès le démarrage.

Comment éviter les risques liés au RAG et à la base documentaire interne ?

Mettre en place un cloisonnement par équipe ou par projet, sécuriser la base vectorielle et vérifier les permissions d’accès. Assurer une gouvernance des données et des logs d’inférence pour la traçabilité et le respect du RGPD et de l’AI Act.

Quels sont les pièges fréquents lors d’une installation locale ?

Télécharger des modèles depuis des sources non vérifiées, exposer l’endpoint sans protection, ignorer les logs et la traçabilité, et supposer que « local = sûr » sans mettre en place des contrôles d’accès et de sécurité additionnels.

Où trouver des ressources pour approfondir les bonnes pratiques d’installation sécurisée ?

Consulter des guides et retours d’expérience comme ceux accessibles via les liens mentionnés dans le texte, notamment des ressources dédiées à la sécurité, à la gestion des accès et aux pratiques opérationnelles pour LLM locaux.